TECLADO

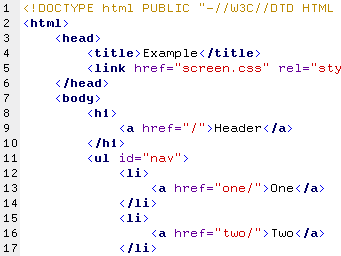

En

informática un

teclado es un

periférico de entrada o dispositivo, en parte inspirado en el teclado de las

máquinas de escribir, que utiliza una disposición de botones o teclas, para que actúen como palancas mecánicas o interruptores electrónicos que envían información a la computadora. Después de las tarjetas perforadas y las cintas de papel, la interacción a través de los teclados al estilo teletipo se convirtió en el principal medio de entrada para las computadoras. El teclado tiene entre 99 y 108 teclas aproximadamente, y está dividido en cuatro bloques:

1. Bloque de funciones: Va desde la tecla F1 a F12, en tres bloques de cuatro: de F1 a F4, de F5 a F8 y de F9 a F12. Funcionan de acuerdo al programa que esté abierto. Por ejemplo, en muchos programas al presionar la tecla F1 se accede a la ayuda asociada a ese programa.

2. Bloque alfanumérico: Está ubicado en la parte inferior del bloque de funciones, contiene los números arábigos del 1 al 0 y el alfabeto organizado como en una máquina de escribir, además de algunas teclas especiales.

3. Bloque especial: Está ubicado a la derecha del bloque alfanumérico, contiene algunas teclas especiales como Imp Pant, Bloq de desplazamiento, pausa, inicio, fin, insertar, suprimir, RePag, AvPag, y las flechas direccionales que permiten mover el punto de inserción en las cuatro direcciones.

4. Bloque numérico: Está ubicado a la derecha del bloque especial, se activa al presionar la tecla Bloq Num, contiene los números arábigos organizados como en una calculadora con el fin de facilitar la digitación de cifras. Además contiene los signos de las cuatro operaciones básicas: suma +, resta -, multiplicación * y division /; también contiene una tecla de Intro o Enter.

HISTORIA

Disposición de las teclas

La disposición de las teclas se remonta a las primeras

máquinas de escribir, las cuales eran enteramente mecánicas. Al pulsar una letra en el teclado, se movía un pequeño martillo mecánico, que golpeaba el papel a través de una cinta impregnada en tinta. Al escribir con varios dedos de forma rápida, los martillos no tenían tiempo de volver a su posición por la frecuencia con la que cada letra aparecía en un texto. De esta manera la pulsación era más lenta con el fin de que los martillos se atascaran con menor frecuencia.

Sobre la distribución de los caracteres en el teclado surgieron dos variantes principales: la francesa

AZERTY y la alemana

QWERTY. Ambas se basaban en cambios en la disposición según las teclas más frecuentemente usadas en cada idioma. A los teclados en su versión para el idioma español además de la

Ñ, se les añadieron los caracteres de acento agudo (

´), grave (

`) y circunflejo (

^)), además de la

cedilla (

Ç) aunque estos caracteres son de mayor uso en francés, portugués o en catalán.

Cuando aparecieron las máquinas de escribir eléctricas, y después los ordenadores, con sus teclados también eléctricos, se consideró seriamente modificar la distribución de las letras en los teclados, colocando las letras más corrientes en la zona central; es el caso del

Teclado Simplificado Dvorak. El nuevo teclado ya estaba diseñado y los fabricantes preparados para iniciar la fabricación. Sin embargo, el proyecto se canceló debido al temor de que los usuarios tuvieran excesivas incomodidades para habituarse al nuevo teclado, y que ello perjudicara la introducción de las computadoras personales, que por aquel entonces se encontraban en pleno auge.

Primeros teclados

Además de teletipos y máquinas de escribir eléctricas como la

IBM Selectric, los primeros teclados solían ser un

terminal de computadora que se comunicaba por

puerto serial con la computadora. Además de las normas de teletipo, se designó un estándar de comunicación serie, según el tiempo de uso basado en el juego de caracteres

ANSI, que hoy sigue presente en las comunicaciones por módem y con impresora (las primeras computadoras carecían de

monitor, por lo que solían comunicarse, o bien por luces en su panel de control, o bien enviando la respuesta a un dispositivo de impresión). Se usaba para ellos las secuencias de escape, que se generaban o bien por teclas dedicadas, o bien por combinaciones de teclas, siendo una de las más usadas la tecla Control.

La llegada de la

computadora doméstica trae una inmensa variedad de teclados y de tecnologías y calidades (desde los muy reputados por duraderos del

Dragon 32 a la fragilidad de las membranas de los equipos Sinclair), aunque la mayoría de equipos incorporan la

placa madre bajo el teclado, y es la

CPU o un circuito auxiliar (como el chip de sonido

General Instrument AY-3-8910 en los

MSX) el encargado de leerlo. Son casos contados los que recurren o soportan comunicación serial (curiosamente es la tecnología utilizada en el

Sinclair Spectrum 128 para el keypad numérico). Sólo los MSX establecerán una norma sobre el teclado, y los diferentes clones del

TRS-80 seguirán el diseño del clonado.

Generación 16 bits

Mientras que el teclado del

IBM PC y la primera versión del

IBM AT no tuvo influencia más allá de los clónicos PC, el Multifunción II (o teclado extendido AT de 101/102 teclas) aparecido en

1987 refleja y estandariza

de facto el teclado moderno con cuatro bloques diferenciados : un bloque alfanumérico con al menos una tecla a cada lado de la barra espaciadora para acceder a símbolos adicionales; sobre él una hilera de 10 o 12

teclas de función; a la derecha un teclado numérico, y entre ambos grandes bloques, las teclas de cursor y sobre ellas varias teclas de edición. Con algunas variantes este será el esquema usado por los

Atari ST, los Commodore Amiga (desde el

Commodore Amiga 500), los

Sharp X68000, las estaciones de trabajo SUN y

Silicon Graphics y los

Acorn Archimedes/

Acorn RISC PC. Sólo los Mac siguen con el esquema bloque alfanumérico + bloque numérico, pero también producen teclados extendidos AT, sobre todo para los modelos con emulación PC por hardware.

Mención especial merece la serie 55 de teclados IBM, que ganaron a pulso la fama de "indestructibles", pues tras más de 10 años de uso continuo en entornos como las aseguradoras o la administración pública seguían funcionando como el primer día.

Con la aparición del

conector PS/2, varios fabricantes de equipos no PC proceden a incorporarlo en sus equipos. Microsoft, además de hacerse un hueco en la gama de calidad alta, y de presentar avances ergonómicos como el

Microsoft Natural Keyboard, añade 3 nuevas teclas tras del lanzamiento de

Windows 95. A la vez se generalizan los teclados

multimedia que añaden teclas para controlar en el PC el volumen, el lector de

CD-ROM o el navegador, incorporan en el teclado altavoces, calculadora, almohadilla sensible al tacto o bola trazadora

Teclados con USB

Aunque los teclados

USB comienzan a verse al poco de definirse el estándar USB, es con la aparición del

Apple iMac, que trae tanto teclado como mouse USB de serie cuando se estandariza el soporte de este tipo de teclado. Además tiene la ventaja de hacerlo independiente del hardware al que se conecta. El estándar define scancodes de 16 bits que se transmiten por la interfaz. Del 0 al 3 son códigos de error del protocolo, llamados NoEvent, ErrorRollOver, POSTFail, ErrorUndefined, respectivamente. Del 224 al 231 se reservan para las teclas modificadoras (LCtrl, LShift, LAlt, LGUI, RCtrl, RShift, RAlt, RGUI)

Existen distintas disposiciones de teclado, para que se puedan utilizar en diversos lenguajes. El tipo estándar de teclado inglés se conoce como

QWERTY. Denominación de los teclados de computadora y

máquinas de escribir que se utilizan habitualmente en los países occidentales, con alfabeto latino. Las siglas corresponden a las primeras letras del teclado, comenzando por la izquierda en la fila superior. El teclado en español o su variante latinoamericana son teclados

QWERTY que se diferencian del inglés por presentar la letra "ñ" y "Ñ" en su distribución de teclas.

Se han sugerido distintas alternativas a la disposición de teclado

QWERTY, indicando ventajas tales como mayores velocidades de tecleado. La alternativa más famosa es el

Teclado Simplificado Dvorak.

Sólo las teclas etiquetadas con una letra en mayúscula pueden ofrecer ambos tipos: mayúsculas y minúsculas. Para teclear un símbolo que se encuentra en la parte superior izquierda de una tecla, se emplea la tecla mayúsculas, etiquetada como "↑". Para teclear un símbolo que se encuentra en la parte inferior derecha de una tecla, se emplea la tecla Alt-Gr.

Teclas inertes

Algunas lenguas incluyen caracteres adicionales al teclado inglés, como los caracteres acentuados. Teclear los caracteres acentuados resulta más sencillo usando las teclas inertes. Cuando se utiliza una de estas teclas, si se presiona la tecla correspondiente al acento deseado nada ocurre en la pantalla, por lo que, a continuación se debe presionar la tecla del carácter a acentuar. Esta combinación de teclas requiere que se teclee una secuencia aceptable. Por ejemplo, si se presiona la tecla inerte del acento (ej.

´) seguido de la letra

A, obtendrá una "a" acentuada (á). Sin embargo, si se presiona una tecla inerte y a continuación la tecla

T, no aparecerá nada en la pantalla o aparecerán los dos caracteres por separado (´t), a menos que la fuente particular para su idioma incluya la "t" acentuada.

Para teclear una marca de acento

diacrítico, simplemente se presiona la tecla inerte del acento, seguida de la barra de espacio.

Tipos de teclado

Hubo y hay muchos teclados diferentes, dependiendo del idioma, fabricante…

IBM ha soportado tres tipos de teclado: el

XT, el

AT y el

MF-II.

El primero (

1981) de éstos tenía 83 teclas, usaban es

Scan Code set1, unidireccionales y no eran muy ergonómicos, ahora está obsoleto.

Más tarde (

1984) apareció el teclado

PC/AT con 84 teclas (una más al lado de SHIFT IZQ), ya es bidireccional, usa el Scan Code set 2 y al igual que el anterior cuenta con un

conector DIN de 5 pines.

En

1987 IBM desarrolló el

MF-II (Multifunción II o teclado extendido) a partir del AT. Sus características son que usa la misma interfaz que el AT, añade muchas teclas más, se ponen leds y soporta el Scan Code set 3, aunque usa por defecto el 2. De este tipo hay dos versiones, la americana con 101 teclas y la europea con 102.

Los teclados PS/2 son básicamente iguales a los MF-II. Las únicas diferencias son el

conector mini-DIN de 6 pines (más pequeño que el AT) y más comandos, pero la comunicación es la misma, usan el protocolo AT. Incluso los

ratones PS/2 usan el mismo protocolo.

Hoy en día existen también los teclados en pantalla, también llamados teclados virtuales, que son (como su mismo nombre indica) teclados representados en la pantalla, que se utilizan con el

ratón o con un dispositivo especial (podría ser un

joystick). Estos teclados lo utilizan personas con discapacidades que les impiden utilizar adecuadamente un teclado fisico.

Actualmente la denominación AT ó PS/2 sólo se refiere al conector porque hay una gran diversidad de ellos.

Estructura

Un teclado realiza sus funciones mediante un micro controlador. Estos micro controladores tienen un programa instalado para su funcionamiento, estos mismos programas son ejecutados y realizan la exploración matricial de las teclas cuando se presiona alguna, y así determinar cuales están pulsadas.

Para lograr un sistema flexible los microcontroladores no identifican cada tecla con su carácter serigrafiado en la misma sino que se adjudica un valor numérico a cada una de ellas que sólo tiene que ver con su posición física. El teclado latinoamericano sólo da soporte con teclas directas a los caracteres específicos del castellano, que incluyen dos tipos de acento, la letra eñe y los signos de exclamación e interrogación. El resto de combinaciones de acentos se obtienen usando una tecla de extensión de grafismos. Por lo demás el teclado latinoamericano está orientado hacia la programación, con fácil acceso al juego de símbolos de la norma ASCII.

Por cada pulsación o liberación de una tecla el micro controlador envía un código identificativo que se llama

Scan Code. Para permitir que varias teclas sean pulsadas simultáneamente, el teclado genera un código diferente cuando una tecla se pulsa y cuando dicha tecla se libera. Si el micro controlador nota que ha cesado la pulsación de la tecla, el nuevo código generado (

Break Code) tendrá un valor de pulsación incrementado en 128. Estos códigos son enviados al circuito micro controlador donde serán tratados gracias al administrador de teclado, que no es más que un programa de la BIOS y que determina qué carácter le corresponde a la tecla pulsada comparándolo con una tabla de caracteres que hay en el kernel, generando una interrupción por hardware y enviando los datos al procesador. El micro controlador también posee cierto espacio de

memoria RAM que hace que sea capaz de almacenar las últimas pulsaciones en caso de que no se puedan leer a causa de la velocidad de tecleo del usuario. Hay que tener en cuenta, que cuando realizamos una pulsación se pueden producir rebotes que duplican la señal. Con el fin de eliminarlos, el teclado también dispone de un circuito que limpia la señal.

En los teclados AT los códigos generados son diferentes, por lo que por razones de compatibilidad es necesario traducirlos. De esta función se encarga el controlador de teclado que es otro microcontrolador (normalmente el 8042), éste ya situado en el PC. Este controlador recibe el Código de Búsqueda del Teclado (

Kscan Code) y genera el propiamente dicho Código de Búsqueda. La comunicación del teclado es vía serie. El protocolo de comunicación es bidireccional, por lo que el servidor puede enviarle comandos al teclado para configurarlo, reiniciarlo, diagnósticos, etc.

Disposición del teclado

La

disposición del teclado es la distribución de las teclas del

teclado de una computadora, una máquina de escribir u otro dispositivo similar.

Existen distintas distribuciones de teclado, creadas para usuarios de

idiomas diferentes. El teclado estándar en español corresponde al diseño llamado

QWERTY. Una variación de este mismo es utilizado por los usuarios de lengua inglesa. Para algunos idiomas se han desarrollado teclados que pretenden ser más cómodos que el QWERTY, por ejemplo el

Teclado Dvorak.

Las computadoras modernas permiten utilizar las distribuciones de teclado de varios idiomas distintos en un teclado que físicamente corresponde a un solo idioma. En el sistema operativo

Windows, por ejemplo, pueden instalarse distribuciones adicionales desde el Panel de Control.

Existen programas como Microsoft Keyboard Layout Creator

KbdEdit,

que hacen muy fácil la tarea de crear nuevas distribuciones, ya para satisfacer las necesidades particulares de un usuario, ya para resolver problemas que afectan a todo un grupo lingüístico. Estas distribuciones pueden ser modificaciones a otras previamente existentes (como el teclado latinoamericano extendido

o el gaélico

), o pueden ser enteramente nuevas (como la distribución para el

Alfabeto Fonético Internacional,

o el panibérico

).

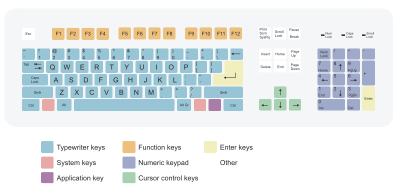

A primera vista en un teclado podemos notar una división de teclas, tanto por la diferenciación de sus colores, como por su distribución. Las teclas grisáceas sirven para distinguirse de las demás por ser teclas especiales (borrado, teclas de función, tabulación, tecla del sistema…). Si nos fijamos en su distribución vemos que están agrupadas en cuatro grupos:

- Teclas de función: situadas en la primera fila de los teclados. Combinadas con otras teclas, nos proporcionan acceso directo a algunas funciones del programa en ejecución.

- Teclas de edición: sirven para mover el cursor por la pantalla.

- Teclas alfanuméricas: son las más usadas. Su distribución suele ser la de los teclados QWERTY, por herencia de la distribución de las máquinas de escribir. Reciben este nombre por ser la primera fila de teclas, y su orden es debido a que cuando estaban organizadas alfabéticamente la máquina tendía a engancharse, y a base de probar combinaciones llegaron a la conclusión de que así es como menos problemas daban. A pesar de todo esto, se ha comprobado que hay una distribución mucho más cómoda y sencilla, llamada Dvorak, pero en desuso debido sobre todo a la incompatibilidad con la mayoría de los programas que usamos.

- Bloque numérico: situado a la derecha del teclado. Comprende los dígitos del sistema decimal y los símbolos de algunas operaciones aritméticas. Añade también la tecla especial Bloq Num, que sirve para cambiar el valor de algunas teclas para pasar de valor numérico a desplazamiento de cursor en la pantalla. el teclado numérico también es similar al de un calculadora cuenta con las 4 operaciones básicas que son + (suma), - (resta), * (multiplicación) y / (división).

Clasificación de teclados de computadoras

En el mercado hay una gran variedad de teclados. Según su forma física:

- Teclado XT de 83 teclas: se usaba en el PC XT (8086/88).

- Teclado AT de 83 teclas: usado con los PC AT (286/386).

- Teclado expandido de 101/102 teclas: es el teclado actual, con un mayor número de teclas.

- Teclado Windows de 103/104 teclas: el teclado anterior con 3 teclas adicionales para uso en Windows.

- Teclado ergonómico: diseñados para dar una mayor comodidad para el usuario, ayudándole a tener una posición más relajada de los brazos.

- Teclado multimedia: añade teclas especiales que llaman a algunos programas en el computador, a modo de acceso directo, como pueden ser el programa de correo electrónico, la calculadora, el reproductor multimedia…

- Teclado inalámbrico: suelen ser teclados comunes donde la comunicación entre el computador y el periférico se realiza a través de rayos infrarrojos, ondas de radio o mediante bluetooth.

- Teclado flexible: Estos teclados son de plástico suave o silicona que se puede doblar sobre sí mismo. Durante su uso, estos teclados pueden adaptarse a superficies irregulares, y son más resistentes a los líquidos que los teclados estándar. Estos también pueden ser conectados a dispositivos portátiles y teléfonos inteligentes. Algunos modelos pueden ser completamente sumergidos en agua, por lo que hospitales y laboratorios los usan, ya que pueden ser desinfectados.

Según la tecnología de sus teclas se pueden clasificar como teclados de cúpula de goma, teclados de membrana: teclados capacitativos y teclados de contacto metálico.

La bicicleta es un vehículo de transporte personal de propulsión humana.Sus componentes básicos son dos ruedas, generalmente de igual diámetro y dispuestas en línea, un sistema de transmisión a pedales, un marco metálico que le da la estructura e integra los componentes, un manillar para controlar la dirección y un sillín para sentarse. El desplazamiento se obtiene al girar con las piernas la caja de los pedales que a través de una cadena hace girar un piñón que a su vez hace girar la rueda trasera sobre el pavimento.

La bicicleta es un vehículo de transporte personal de propulsión humana.Sus componentes básicos son dos ruedas, generalmente de igual diámetro y dispuestas en línea, un sistema de transmisión a pedales, un marco metálico que le da la estructura e integra los componentes, un manillar para controlar la dirección y un sillín para sentarse. El desplazamiento se obtiene al girar con las piernas la caja de los pedales que a través de una cadena hace girar un piñón que a su vez hace girar la rueda trasera sobre el pavimento.